삽질블로그

[Kali_Linux] Robots File | bWAPP | Security Misconfiguration 본문

본 내용은 교육 과정에서 필요한 실습 목적으로 구성된 것이며, 혹시라도 개인적인 용도 및 악의적인 목적으로 사용할 경우, 법적 책임은 본인에게 있다는 것을 알려드립니다.

1. Security Misconfiguration

- 잘못된 보안 구성

- 서버 / 시스템 / DB / 네트워크 장비 / 웹 설정 오류로 인하여 발생하는 취약점이다.

- Ex) 디렉토링 리스팅, 에러페이지, 웹페이지 주석, 웹서버 기본 설정, Adobe Flash 취약점, Dos/DDos공격,

특정 서비스에 대한 Reverse_TCP 공격, 로컬 권한 취약점, 백업 / 임시 / robots 파일

2. 'robots.txt'

- 검색 엔진을 통해서 정보를 검색하는 것을 제어할 때 사용하는 파일이다.

- 만약, 중요한 디렉토리, 파일들이 검색이 된다면, 디렉토리 리스팅에 의해서 정보가 노출되는 문제가 발생한다.

- 또한, 'roots.txt' 파일은 웹-서버 홈 디렉터리에 생성하고 관리해야 한다.

- 명령어 형식은 다음과 같다.

User-agent: * 모든 검색 엔진

User-agent: googlebot 구글 검색 엔진

Allow: / 모든 디렉토리 접근 허용

Disallow: abc.ini 'abc.ini' 파일 검색 차단

Disallow: /admin/ 'admin' 디렉터리 접근 차단

Disallow: 사이트 크롤링 가능

3. 크롤링

- 웹 페이지 내용을 이용하여 문서 또는 파일 정보를 추출 / 검색하는 기능이다.

- 또한, 웹 상의 다양한 정보를 자동으로 검색하고 색인하기 위해 사용한다.

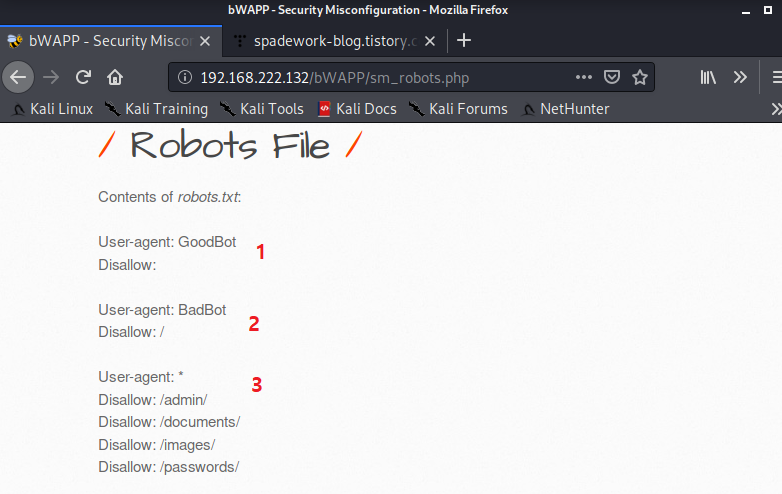

4. Security Misconfiguration - Robots File

- 이 시나리오는 bWAPP의 'robots.txt' 파일 내용을 확인하는 내용이다.

=====================실습==============================

1) 첫 화면

2) spadework-blog.tistory.com/robots.txt 제 블로그에 적용

1. 모든 봇들은 /owner, /manage, /admin, /oldadmin, /search, /m/search, /m/admin, /like 디렉토리 접근이 불가능하다.

2. 그 외 나머지 디렉토리는 접근이 가능하다.

3. 'Mediapartners-Google' 봇은 모든 디렉토리 접근이 가능하다.

3)

1. GoodBot은 사이트 크롤링 가능

2. BadBot은 모든 디렉토리 접근이 불가능

3. 모든 봇들은 해당 디렉토리 접근 불가능

4) /admin 디렉토리 내용 확인

검색엔진이아니라 본인 것이니까 들어가짐

5) /documents 디렉토리 내용 확인

6) /images 디렉토리 내용 확인

7) /passwords 디렉토리 내용 확인